On the 30th day of the war against the Islamic Republic, X user ARIX (@arixolin), who closely tracks the conflict's information space, published a warning that cut through the noise. In a single post, he mapped out exactly how fake accounts are manufacturing kill claims about IRGC commanders for profit:

در سیامین روز جنگ علیه جمهوری اسلامی، کاربر ARIX در پلتفرم ایکس که فضای اطلاعاتی جنگ را از نزدیک رصد میکند، هشداری منتشر کرد که توجه هزاران نفر را جلب کرد. او در یک پست، ساختار دقیق عملکرد اکانتهای جعلی که ادعای ترور مقامات رژیم را برای کسب درآمد میسازند ترسیم کرد:

ARIX @arixolin

Mar 29, 2026۹ فروردین ۲۵۸۵

اکانتهای فارم هندی یه چیزی یاد گرفتن و چند روزه دارن هی خبر تایید نشده پخش میکنن.

یه سری اکانت اوسینت فیک اسرائیلی درست کردن، نقطهزنیها رو سریع ربط میدن به اسم یه کسی که میدونن ایمپرشن میگیره. بعد همون خبر تایید نشده رو با شدت بالا تو بقیه اکانتهای فارم خودشون تکرار میکنن، تا جایی که بالاخره خبر از یه خبرگزاری یا اکانتهای با اعتبار بیشتر پخش بشه.

متاسفانه خبر مربوط به وحیدی و قالیباف هر دو از همین طریق داره پخش میشه.

با اخباری که بهشدت برامون مهمه اینجوری دارن با روح و روانمون بازی میکنن!

این باعث میشه حتی خبر اگه درست باشه، زمانی که از کانالهای رسمی اعلام میشه، اهمیت و ارزش خبریش رو از دست داده باشه.

Indian farm accounts have learned something and for the past few days have been constantly spreading unconfirmed news.

They've created fake Israeli OSINT accounts. They quickly attribute airstrikes to the name of someone they know will get impressions. Then they repeat the same unconfirmed news at high volume across their other farm accounts, until eventually the news gets picked up by a news agency or higher-credibility accounts.

Unfortunately, the news about Vahidi and Ghalibaf is both being spread through exactly this method.

They're playing with our emotions using news that matters deeply to us!

This causes even if the news turns out to be true, by the time it's announced through official channels, it has already lost its news value and significance.

This warning was seen thousands of times in a single day. It describes a pattern that IRNEWS had already caught through its own editorial process: fake accounts fabricating kill claims about IRGC commanders to farm engagement and revenue. We investigated. This article explains what we found, so you can spot it yourself.

این هشدار که در یک روز هزاران بار دیده شده است، الگویی را توصیف میکند که تحریریه ایراننیوز پیشتر در جریان کار خود با آن مواجه شده بود: شبکهای از اکانتهای جعلی که با انتشار ادعاهای دروغین درباره ترور مقامات رژیم، بازدید و درآمد کسب میکنند. ما موضوع را پیگیری کردیم و این مقاله یافتههایمان را شرح میدهد تا شما هم بتوانید این الگو را بشناسید و فریب نخورید.

53۵۳

False claims tracked

by NewsGuardادعای نادرست ثبتشده

نیوزگارد

31۳۱

Accounts hacked

for "Iran War Monitor"اکانت هکشده

«ایران وار مانیتور»

70++۷۰

IRGC fake accounts

blocked in one sweepاکانت جعلی سپاه

مسدود شده در یک مرحله

How the Pipeline Works

خط تولید دروغ چگونه کار میکند

Every fake kill claim follows the same six steps. Once you see the pattern, you will never fall for it again:

هر ادعای جعلی ترور مسیر یکسانی را طی میکند. وقتی این الگو را بشناسید، دیگر فریب نخواهید خورد:

1۱

Real strike happensحمله واقعی رخ میدهد

Coalition strikes are real. Explosions are real. This is the foundation the farms exploit.حملات ائتلاف و انفجارها واقعیاند و همین واقعیت بستری است که فارمها از آن سوءاستفاده میکنند.

2۲

Farm picks up the eventفارم رویداد واقعی را شکار میکند

The farm operator spots the real strike and picks a regime official's name that will generate maximum impressions. Vahidi, Ghalibaf, Jannati — the bigger the name, the more engagement, the more revenue.اپراتور فارم حمله واقعی را رصد میکند و نام مقامی را انتخاب میکند که بیشترین بازدید را بگیرد. وحیدی، قالیباف، جنتی — هرچه نام بزرگتر، تعامل بیشتر و درآمد بالاتر.

3۳

Fake OSINT account posts the claimاکانت جعلی اوسینت ادعا را منتشر میکند

A fake "Israeli intelligence" or "war monitor" account publishes a "BREAKING" post attributing the strike to the chosen name. The account looks credible at first glance.یک اکانت جعلی «اطلاعات اسرائیل» یا «رصد جنگ» پستی «فوری» منتشر میکند و حمله را به نام انتخابشده نسبت میدهد. اکانت در نگاه اول معتبر به نظر میرسد.

4۴

Farm network amplifiesشبکه فارم ادعا را تقویت میکند

Dozens of other accounts in the same network repost the claim simultaneously, creating the illusion of multiple independent sources confirming the same news.دهها اکانت دیگر در همان شبکه، ادعا را بهطور همزمان بازنشر میکنند و توهم تایید خبر از چندین منبع مستقل ایجاد میشود.

5۵

Real outlets pick it upرسانههای واقعی آن را بازنشر میکنند

Seeing the claim on "multiple accounts," some news outlets report it as "unconfirmed reports say..." without verifying the original source.رسانهها با دیدن ادعا در «چندین اکانت» آن را با عنوان «گزارشهای تایید نشده حاکی است...» منتشر میکنند، بدون اینکه منبع اصلی را بررسی کنند.

6۶

The damage is doneآسیب وارد شده

By the time the claim is debunked, thousands have celebrated or grieved for nothing. Trust in real news erodes. Next time a genuine kill is confirmed, the audience is confused and hesitant. The farm got paid. You got exhausted. Real journalism lost its impact.تا زمانی که ادعا تکذیب شود، هزاران نفر بیدلیل شادمانی کرده یا غمگین شدهاند. اعتماد به اخبار واقعی کمرنگتر شده. دفعه بعد که یک ترور واقعی تایید شود، مخاطب سردرگم است و تردید دارد. فارم به درآمدش رسیده، شما خسته شدهاید و خبرنگاری واقعی تاثیرش را از دست داده.

Case Study: "Baba Banaras"

نمونه واقعی: «بابا باناراس»

ARIX pointed to a specific account: "Baba Banaras" (@RealBababanaras), an India-based X account with 136,000 followers. Bio: "Defence enthusiastic, My religion is India." Multiple fact-checking organisations have flagged it for fabricated Iran war content. Here are examples of the kind of claims that circulate through these farm networks:

ARIX به عنوان نمونه به اکانت «بابا باناراس» اشاره کرد: اکانتی هندی در ایکس با ۱۳۶ هزار دنبالکننده. در معرفی خود نوشته «علاقهمند به دفاع، مذهب من هند است.» چندین سازمان راستیآزمایی این اکانت را به دلیل انتشار مکرر اخبار جعلی درباره جنگ ایران شناسایی و گزارش کردهاند. نمونههایی از این دست ادعاها که در شبکه فارمها پخش شدهاند:

❌

"Qaani executed by IRGC" (Mar 5)«قاآنی توسط سپاه اعدام شد» (۵ مارس)

Photo of Qaani with a noose graphic. 8,200 views, 251 reposts. Entirely fabricated. No credible source has confirmed Qaani's death.عکس قاآنی با گرافیک طناب دار. ۸,۲۰۰ بازدید، ۲۵۱ بازنشر. کاملا ساختگی. هیچ منبع معتبری مرگ قاآنی را تایید نکرده.

❌

"Ghalibaf killed" (circulated late Mar)«قالیباف کشته شد» (اواخر مارس)

ARIX specifically named this as a farm-spread claim. Ghalibaf issued public statements on Mar 29-30, confirmed by AFP, NYT, Guardian, and NPR. Alive and leading the war effort.ARIX این ادعا را نمونهای از عملکرد فارمها دانست. قالیباف در ۹ و ۱۰ فروردین بیانیه عمومی صادر کرد که خبرگزاری فرانسه، نیویورک تایمز، گاردین و انپیآر آن را بازتاب دادند. زنده و فعال در مدیریت جنگ.

❌

"Ahmad Jannati dead" (Mar 28-29)«احمد جنتی مرد» (۲۸-۲۹ مارس)

Farm accounts confused Ahmad Jannati (99yo Guardian Council chief) with his brother Mohammad Taqi Jannati who was reportedly killed in Qom. Regime media explicitly denied Ahmad Jannati's death. Classic farm error: not knowing the subject.اکانتهای فارم احمد جنتی (دبیر ۹۹ ساله شورای نگهبان) را با برادرش محمدتقی جنتی که گزارش شده در قم کشته شده اشتباه گرفتند. رسانههای رژیم صریحا مرگ احمد جنتی را تکذیب کردند. خطای کلاسیک فارم: نشناختن سوژه.

The same pattern appeared in a "BREAKING" claim that IRGC Commander Vahidi had been assassinated. IRNEWS investigated and found the claim came from an Arabic X Blue subscriber who got Vahidi's appointment date wrong by 23 days. No credible outlet covered it. Vahidi was alive and commanding the next day.

همین الگو در ادعای «فوری» ترور احمد وحیدی، فرمانده کل سپاه پاسداران، نیز مشاهده شد. بر اساس بررسی ایراننیوز، منشا این ادعا یک اکانت عربیزبان با اشتراک بلو ایکس بود که تاریخ انتصاب وحیدی را ۲۳ روز اشتباه درج کرده بود. تا پایان روز هیچ رسانه معتبری این خبر را بازتاب نداد و روز بعد وحیدی زنده و در حال فرماندهی تایید شد.

Why Does This Exist? The Money

چرا این اکوسیستم وجود دارد؟ پول

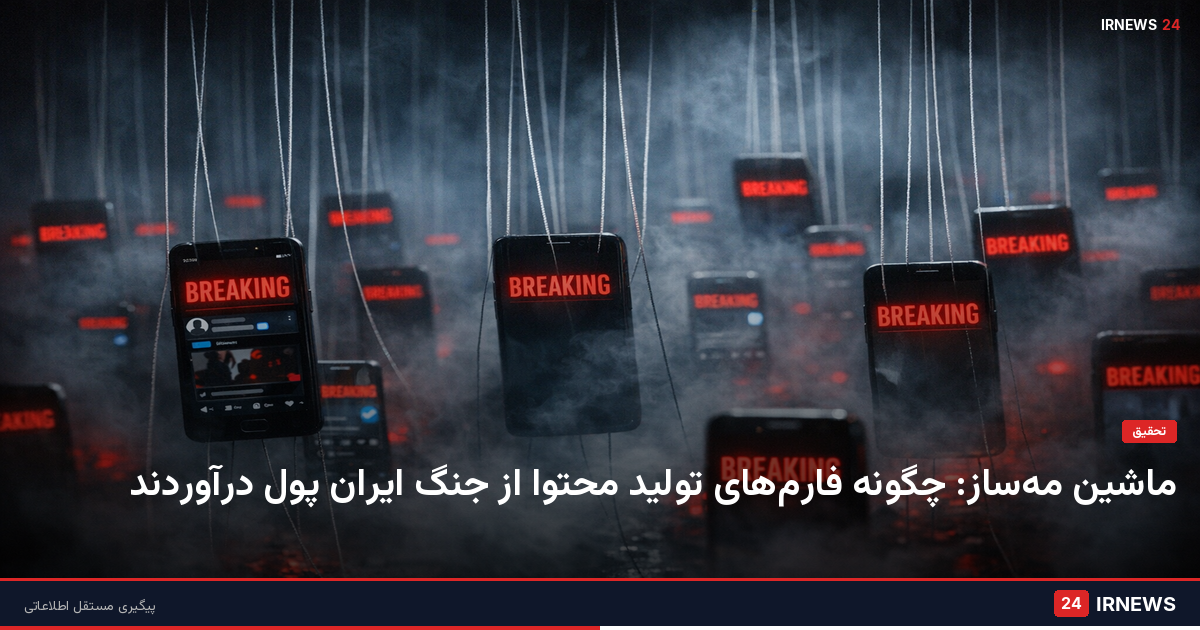

X pays verified Blue subscribers based on how many views their posts generate. During the Iran war, unverified kill claims became one of the most profitable content categories. The more dramatic the claim, the more views, the more money.

پلتفرم ایکس به صاحبان اکانتهای تایید شده که اشتراک بلو دارند، بر اساس تعداد بازدید پستهایشان پول پرداخت میکند. در جریان جنگ ایران، ادعاهای تایید نشده ترور فرماندهان به یکی از پرسودترین دستههای محتوا تبدیل شد. هرچه ادعا جنجالیتر، بازدید بیشتر و درآمد بالاتر.

In one documented case, a Pakistan-based operator hacked 31 accounts, renamed them all "Iran War Monitor," and posted AI-generated fake war videos purely for ad revenue. X's own head of product confirmed the operation. The accounts were removed, but the incentive system that made it profitable was never fixed.

در یک نمونه مستند، اپراتوری مستقر در پاکستان ۳۱ اکانت را هک کرده، نام همه را به «ایران وار مانیتور» تغییر داده و ویدیوهای جعلی جنگ ساختهشده با هوش مصنوعی منتشر کرده است؛ تنها انگیزهاش کسب درآمد تبلیغاتی بوده است. مدیر محصول ایکس شخصا وجود این عملیات را تایید کرده و اکانتها مسدود شدهاند، اما ساختاری که چنین کاری را سودآور کرده بود تغییری نکرده است.

X announced a 90-day monetisation ban for unlabelled AI war content. The Guardian and TechCrunch covered the policy. Then Elon Musk reversed the enforcement after creator backlash. The rule exists on paper. Enforcement does not.

ایکس در واکنش به این موج اعلام کرد هر کسی ویدیوی جنگی ساختهشده با هوش مصنوعی بدون برچسب منتشر کند، ۹۰ روز از برنامه درآمدزایی محروم خواهد شد. گاردین و تککرانچ هر دو این سیاست را پوشش دادند. اما ایلان ماسک در پی اعتراض تولیدکنندگان محتوا از اجرای آن عقبنشینی کرد. قانون روی کاغذ وجود دارد، اجرا نه.

Not Just Farms: Three Operations, One Fog

فقط فارم نیست: سه عملیات، یک مه

When the volume of fake news grows so high that audiences can no longer tell real from false, a fog descends over the information space. That fog is not created by farms alone. Three very different operations contribute to it:

وقتی حجم اخبار جعلی آنقدر بالا برود که مخاطب دیگر نتواند خبر واقعی را از دروغ تشخیص دهد، فضایی ایجاد میشود که ما این فضا را «مه» مینامیم. فارمها تنها سازندگان این مه نیستند. سه عملیات کاملا متفاوت در این فضا فعالاند:

🇮🇷

Islamic Republicجمهوری اسلامی

Fake Israeli/Mossad accounts to mislead the public, identify Iranians helping the coalition, and suppress dissent. Also networks of fake Western personas like Scottish independence supporters that pivoted to regime propaganda when the war began. Confirmed by BBC and The Times.ساخت اکانتهای جعلی اسرائیلی و موساد برای گمراه کردن مردم، شناسایی ایرانیانی که به ائتلاف کمک میکنند و سرکوب مخالفان. همچنین شبکههایی از شخصیتهای جعلی غربی مانند هواداران استقلال اسکاتلند که با شروع جنگ به تبلیغات رژیم تغییر جهت دادند. بیبیسی و تایمز وجود این اکانتها را تایید کردهاند.

🇮🇱

Israel (PRISONBREAK)اسرائیل (PRISONBREAK)

Digital warfare operation to counter regime propaganda and encourage Iranian resistance. 50+ profiles with anti-regime content. Documented by University of Toronto's Citizen Lab.عملیات دیجیتال در راستای مقابله با تبلیغات رژیم و تشویق مردم ایران به مقاومت. بیش از ۵۰ پروفایل با محتوای ضدرژیم. آزمایشگاه شهروندی دانشگاه تورنتو این عملیات را مستند کرده است.

💰

Content Farmsفارمهای محتوا

South Asian impression farms, the Pakistan "Iran War Monitor" hack, aggregator sites. No ideology. Pure profit from X's monetisation programme.فارمهای ایمپرشن جنوب آسیا، هک «ایران وار مانیتور» پاکستان، سایتهای تجمیعکننده. بدون ایدئولوژی. فقط سود خالص از برنامه درآمدزایی ایکس.

The motivations are not the same. The IRGC fabricates to mislead the Iranian people and hunt dissidents. Israel conducts legitimate digital warfare against the regime. Farms manufacture lies for money, with no allegiance to anyone. But the practical result for you is the same: an information space so crowded with contradictory claims that distinguishing reality becomes exhausting. These three operations are not coordinated with each other. There is no shared command room. But because all three operate in the same information space simultaneously, they produce a fog that makes it harder for everyone to find the truth.

انگیزهها یکسان نیست. سپاه پاسداران با هدف گمراه کردن مردم ایران و شناسایی مخالفان جعلسازی میکند. اسرائیل در چارچوب جنگ مشروع علیه رژیم، عملیات دیجیتال انجام میدهد. فارمها بدون هیچ تعهدی، صرفا به خاطر پول خبر دروغ پخش میکنند. اما نتیجه عملی برای شما یکی است: فضایی پر از ادعاهای متناقض که تشخیص واقعیت را دشوار میکند. نکته مهم اینجاست که این سه عملیات با یکدیگر هماهنگ نیستند و هیچ اتاق فرمان مشترکی وجود ندارد. اما فعالیت همزمانشان در یک فضای اطلاعاتی، مهای ایجاد کرده که عبور از آن برای همه دشوار است.

The Fabrication Factory

کارخانه جعل

The raw material is increasingly AI-generated. AFP documented Tehran Times publishing a fake satellite image of Al-Udeid Air Base destruction, traced to a manipulated Google Earth frame. ARMA 3 video game footage circulated as real strikes on TikTok. A deepfake of Netanyahu speaking Farsi was posted on official Israeli channels. The IRGC claimed 650 Americans killed in one strike; the Pentagon confirmed six. NewsGuard has catalogued 53 distinct false claims as of late March 2026.

مواد اولیهای که این شبکهها از آن استفاده میکنند، روز به روز بیشتر با هوش مصنوعی ساخته میشود. بر اساس تحقیقات خبرگزاری فرانسه، رسانه دولتی تهران تایمز تصویری ماهوارهای از تخریب ادعایی پایگاه العدید در قطر منتشر کرد که در واقع از روی یک تصویر گوگل ارث متعلق به فوریه ۲۰۲۵ با ابزارهای هوش مصنوعی دستکاری شده بود. فیلمی از بازی ویدیویی آرما ۳ با عنوان تصاویر واقعی حمله در تیکتاک دست به دست شد. ویدیویی دیپفیک از نتانیاهو که به ظاهر به زبان فارسی صحبت میکند، از کانالهای رسمی اسرائیل پخش شد. سپاه پاسداران مدعی کشته شدن ۶۵۰ نظامی آمریکایی در یک حمله به بحرین شد، در حالی که پنتاگون تنها شش کشته را تایید کرد. سازمان نیوزگارد تاکنون ۵۳ ادعای نادرست مجزا درباره این جنگ را شناسایی و ثبت کرده است.

The Tangsiri Lesson

درس تنگسیری

The case of IRGC Navy commander Tangsiri is the clearest example of how the fog machine damages real news:

پرونده فرمانده نیروی دریایی سپاه تنگسیری واضحترین نمونه از آسیب ماشین مهساز به اخبار واقعی است:

Jan 31, 2026۱۱ بهمن ۲۵۸۴

"Terror Alarm" claims Tangsiri assassinated. Explosion in Bandar Abbas. No credible source confirms.اکانت «ترور آلارم» ادعای ترور تنگسیری را منتشر کرد. انفجار در بندرعباس. هیچ منبع معتبری تایید نکرد.

Jan 31, 2026 (hours later)۱۱ بهمن ۲۵۸۴ (ساعاتی بعد)

IRGC denies. Calls "Terror Alarm" unreliable. Says Tangsiri is alive.سپاه تکذیب کرد. اکانت «ترور آلارم» را غیرقابل اعتماد خواند و تنگسیری را زنده اعلام کرد.

Feb — Mar 2026بهمن — فروردین ۲۵۸۵

Story fades without resolution. People don't trust regime media, so the IRGC denial doesn't settle anything. No independent source confirms or debunks. The claim quietly disappears from attention.خبر بدون نتیجهگیری محو شد. مردم به رسانههای رژیم اعتماد ندارند، پس تکذیب سپاه چیزی را حل نکرد. هیچ منبع مستقلی تایید یا تکذیب نکرد. ادعا بیسروصدا از توجهها محو شد.

Mar 26, 2026۶ فروردین ۲۵۸۵

Tangsiri actually killed in coalition strikes on Bandar Abbas. Confirmed by IDF, Iran International, multiple Tier 1-2 sources.تنگسیری واقعا در حملات ائتلاف به بندرعباس کشته شد. ارتش اسرائیل، ایران اینترنشنال و منابع متعدد معتبر تایید کردند.

Mar 26, 2026 (reaction)۶ فروردین ۲۵۸۵ (واکنش)

Confusion when real news arrives. "Wait, didn't we hear this before? Is this the same old claim or actually new?" The real confirmation gets less attention because the audience has already processed and forgotten a version of this story months ago.سردرگمی هنگام رسیدن خبر واقعی. «صبر کنید، مگر این خبر قبلا نیامده بود؟ این همان ادعای قبلی است یا واقعا جدید است؟» تایید واقعی توجه کمتری جلب کرد چون مخاطب ماهها قبل نسخهای از این خبر را شنیده و فراموش کرده بود.

This is the real damage. The fog machine does not create false beliefs. It destroys the capacity to believe anything at all. As ARIX wrote: "Even if the news turns out to be true, by the time it's announced through official channels, it has already lost its news value."

و این دقیقا آسیب اصلی ماشین مهساز است: باور دروغین نمیسازد، بلکه خود توان باورپذیری را نابود میکند. به قول ARIX: «حتی خبر اگه درست باشه، زمانی که از کانالهای رسمی اعلام میشه، اهمیت و ارزش خبریش رو از دست داده باشه.»

Side by Side: Farm Claim vs Verified Kill

مقایسه: ادعای فارم در برابر خبر تایید شده

Here is what a farm claim looks like next to a verified kill report. Learn to recognise the difference instantly:

یک ادعای فارم در کنار یک خبر تایید شده ترور را ببینید. یاد بگیرید تفاوت را فورا تشخیص دهید:

❌ FARM CLAIMادعای فارم

Label:برچسب: BREAKINGفوری

Speed:سرعت: Minutes after a strikeچند دقیقه پس از حمله

Source:منبع: "Reports say..." / "Iranian media..."«گزارشها حاکیست...» / «رسانههای ایرانی...»

Detail:جزئیات: Often wrong (dates, ranks, units)اغلب اشتباه (تاریخ، رتبه، یگان)

Spread:انتشار: 20+ accounts simultaneouslyبیش از ۲۰ اکانت همزمان

Motive:انگیزه: Impressions / ad revenueبازدید / درآمد تبلیغاتی

✅ VERIFIED KILLترور تایید شده

Label:برچسب: Developing / Confirmedدر حال پیگیری / تایید شده

Speed:سرعت: Hours to days after eventساعتها تا روزها پس از رویداد

Source:منبع: "Reuters confirmed..." or "AP reported..." with direct link«رویترز تایید کرد...» یا «اسوشیتدپرس گزارش داد...» با لینک مستقیم

Detail:جزئیات: Accurate ranks, dates, locationsرتبه، تاریخ و محل دقیق

Spread:انتشار: OSINT → Tier 2 → regime/IDF confirmsاوسینت ← رسانه معتبر ← تایید رژیم/ارتش اسرائیل

Motive:انگیزه: Accurate reportingگزارشدهی دقیق

How to Protect Yourself: Red Flags vs Green Flags

چگونه از خودتان محافظت کنید: نشانههای خطر در برابر نشانههای اعتبار

After one month of filtering war claims, these patterns reliably separate farm content from real intelligence:

پس از یک ماه بررسی ادعاهای جنگی، با این الگوها میتوانید محتوای فارم را از اخبار واقعی تشخیص دهید:

🔴

Name attached within minutesنام ظرف چند دقیقه نسبت داده شده

If an official's name appears within minutes of a strike, it is almost certainly fabricated. Real confirmation takes hours to days.

اگر نام مقامی ظرف چند دقیقه پس از حمله ظاهر شود، تقریبا قطعا جعلی است. تایید واقعی ساعتها تا روزها طول میکشد.

🟢

Named outlet confirmsرسانه مشخص تایید کرده

"Reuters reported" or "AFP confirmed" with a direct link. The source is named and verifiable, not "Iranian media says."

«رویترز گزارش داد» یا «خبرگزاری فرانسه تایید کرد» با لینک مستقیم. منبع مشخص و قابل بررسی است، نه «رسانههای ایرانی گزارش دادند.»

🔴

"Iranian media" with no outlet named«رسانههای ایرانی» بدون نام رسانه

Both farms and IRGC accounts use this vague attribution to launder unverified claims. Which outlet? They never say.

هم فارمها و هم اکانتهای سپاه از این عبارت مبهم برای مشروع جلوه دادن ادعاهای بیپایه استفاده میکنند. کدام رسانه؟ هرگز نمیگویند.

🟢

Source chain visibleزنجیره منبع قابل مشاهده

OSINT signal → Tier 2 outlet → regime acknowledgement or IDF confirmation. Each step adds credibility. No shortcuts.

سیگنال اوسینت ← رسانه معتبر ← تایید رژیم یا اعلام ارتش اسرائیل. در هر مرحله اعتبار خبر بیشتر میشود. میانبری وجود ندارد.

🔴

Same claim on 20 accounts at onceهمان ادعا همزمان در ۲۰ اکانت

That is one source amplified, not 20 confirmations. If they all posted within 5 minutes, they are the same operation.

این یک منبع تقویت شده است، نه ۲۰ تایید. اگر همه در بازه ۵ دقیقهای پست کردهاند، بخشی از یک عملیات واحدند.

🟢

Factual details are correctجزئیات واقعی صحیح است

Real intelligence gets ranks, dates, and unit names right. Farm operators don't know the subject. They know the keywords that get impressions.

در اخبار واقعی، رتبهها، تاریخها و نام یگانها دقیق است. گردانندگان فارم سوژه را نمیشناسند و فقط کلمات کلیدی پربازدید را بلدند.

The Numbers: Nearly More Lies Than Truth

آمار: تعداد دروغها تقریبا از واقعیتها بیشتر است

After 30 days of war, the information landscape looks like this:

پس از ۳۰ روز جنگ، منظره اطلاعاتی چنین است:

For every confirmed official killed, there has been more than one false claim circulating. The fog is not a side effect of war. It is a parallel industry.

در برابر هر مقامی که کشته شدنش تایید شده، بیش از یک ادعای دروغین در فضای اطلاعاتی چرخیده است. پخش اطلاعات نادرست عارضه جانبی جنگ نیست، یک صنعت موازی است.

What You Can Do

شما چه میتوانید بکنید

You cannot stop the farms. You cannot shut down the IRGC's fake accounts. You cannot control what X monetises. But you can control your own reaction. Every time you pause before sharing a "BREAKING" claim, every time you check the source chain before celebrating or grieving, every time you refuse to give a farm account the emotional reaction it was designed to extract, the fog machine loses a little bit of its power.

شما نمیتوانید فارمها را متوقف کنید. نمیتوانید اکانتهای جعلی سپاه را ببندید. نمیتوانید سیاستهای درآمدزایی ایکس را تغییر دهید. اما میتوانید واکنش خودتان را کنترل کنید. هر بار که پیش از بازنشر یک ادعای «فوری» مکث کنید، هر بار که زنجیره منبع را پیش از شادمانی یا غم بررسی کنید، هر بار که از دادن واکنش احساسی که فارم برای استخراج آن طراحی شده خودداری کنید، ماشین مهساز کمی از قدرتش را از دست میدهد.

Share this article. Not because IRNEWS wrote it, but because the more of us who recognise these tricks, the less power the farms have to deceive us.

این مقاله را به اشتراک بگذارید. نه به این دلیل که ایراننیوز آن را نوشته، بلکه به این دلیل که هرچه تعداد بیشتری از ما این ترفندها را بشناسیم، قدرت فارمها برای فریب دادنمان کمتر میشود.

The simplest rule: Wait for the source chain, not the claim. A verified kill follows a pattern. A farm claim follows a different one. Learn the difference. It protects your emotional energy for the moments that actually matter.

سادهترین قانون: منتظر زنجیره منبع باشید، نه ادعا. یک خبر تایید شده ترور مسیر مشخصی دارد. ادعای فارم مسیر دیگری. این تفاوت را بشناسید. انرژی احساسیتان را برای لحظاتی نگه دارید که واقعا اهمیت دارند.